luminal

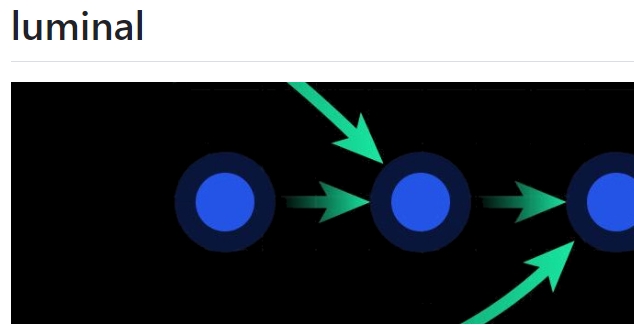

Luminal是一个重视性能的深度学习库,它通过可组合的编译器来实现高性能。下面用通俗语言解释Luminal的功能,并说明在什么情况下会使用它。

Luminal主要功能:

-

高速性能:Luminal旨在成为任何设备上任何模型的最快ML框架。比如,在M系列Macbook上运行Q8 Mistral 7B模型可达到每秒15-25个token。

-

简单性:Luminal的核心始终保持最简设计,目标是让用户能在一个下午的时间内理解整个核心库。

-

RISC风格架构:Luminal将所有操作简化为11个基本操作,涵盖一元、二元和其它操作,足以支持变换器(transformers)、卷积网络(convnets)等。

-

原生实现:Luminal直接用Rust编写,并且直接与CUDA/Metal API交互,没有任何间接层或抽象层,目的是减少复杂性和提升性能。

-

与Pytorch验证对比:正确性对Luminal而言非常重要,它通过大量测试来保证操作的准确性,确保与Pytorch实现的等价性。

使用场景:

Luminal适用于以下场景:

-

性能要求极高的深度学习任务:当你需要在你的深度学习模型中获取尽可能高的性能时,特别是在资源受限(如个人笔记本电脑)或需要高效利用算力的情况下,Luminal提供了一种高性能的解决方案。

-

简化部署流程:如果你希望避免使用复杂的环境(如Docker容器或虚拟环境)来部署你的深度学习模型,Luminal的原生代码和直接的API交互提供了一种更简单的部署方式。

-

编译时错误检查:在深度学习模型开发过程中,数据形状不匹配是一种常见错误。Luminal通过编译时形状检查减少这类错误,适用于追求开发效率和代码质量的场景。

-

优化的实现需求:当标准深度学习框架无法满足特定性能要求时,Luminal提供了通过编译器优化进行深度定制的能力,例如通过内核融合、运行时编译的特定形状内核等方式提升性能。

Luminal是专为追求极端性能、代码简洁性和直接性而设计的深度学习框架。它最适合于对性能有着严格要求、愿意深入底层优化,并且倾向于使用Rust编程语言的深度学习研究者和开发者。

广告:私人定制视频文本提取,字幕翻译制作等,欢迎联系QQ:1752338621