Hallo

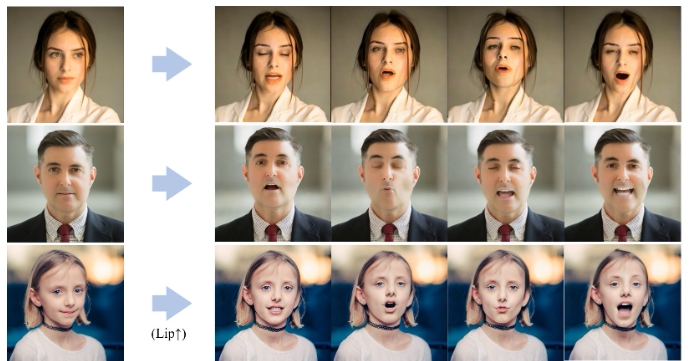

Hallo 是一个由复旦大学和其他几所机构的研究人员开发的分层音频驱动下的人物图像动画合成系统。该系统通过音频输入来驱动人物图像,使其产生逼真的面部动画效果。具体来说,Hallo 能够处理面部的姿态、表情以及唇部的运动,从而生成与输入音频同步的逼真视频动画。

使用场景

- 虚拟形象动画:可以用于生成虚拟主播、虚拟偶像等需要与音频同步的虚拟形象。

- 电影和动画制作:减少人工动画制作的时间和成本,通过音频直接生成角色的面部表情和口型。

- 社交媒体和娱乐:为用户生成高质量的音频驱动的人物动画,增强社交媒体内容的吸引力。

- 教育和培训:应用于在线教育和培训平台,通过虚拟讲师提供身临其境的教学体验。

核心技术与框架

Hallo 的整体框架包括音频分离、面部检测和定位、以及图像和音频的特征投影等模块,再通过分层的方式进行音频驱动的合成。其具体实现包括了多种预训练的模型和依赖工具,如 denoising UNet、face locator、image & audio proj 等。

运行环境要求

- 操作系统:Ubuntu 20.04/22.04

- GPU:测试过的 GPU 包括 A100

- 重要依赖项:需要安装 Python 3.10 及相关依赖库,还需要 ffmpeg。

使用步骤

- 下载并准备预训练模型。

- 准备输入数据(源图像和驱动音频)。

- 使用

scripts/inference.py脚本进行推理。

社会风险与应对措施

开发此类技术会涉及伦理问题,如利用技术生成的深度伪造图像可能被恶意使用。为了减轻这些风险,研究团队建议建立伦理指南和负责任的使用规范,确保数据隐私和个人同意。

未来计划

- 发布训练用的数据准备和训练脚本。

- 优化对中文普通话的推理性能。

- 开放更多的研究职位,欢迎有兴趣的研究人员加入。

如果您在研究中发现该工具有用,请引用相关论文。

广告:私人定制视频文本提取,字幕翻译制作等,欢迎联系QQ:1752338621