DeepSeek-VL2

DeepSeek-VL2是一种先进的大型混合专家(Mixture-of-Experts, MoE)视觉语言模型系列,相比其前身DeepSeek-VL有了显著的提升。该模型系列包含三种变体:DeepSeek-VL2-Tiny、DeepSeek-VL2-Small和DeepSeek-VL2,分别具有10亿、28亿和45亿个激活参数。DeepSeek-VL2在多个任务上展示了卓越的能力,包括视觉问答、光学字符识别、文档/表格/图表理解以及视觉定位等。与现有的开源密集和基于MoE的模型相比,DeepSeek-VL2在相似或更少的激活参数下实现了具有竞争力或领先的性能。

使用场景

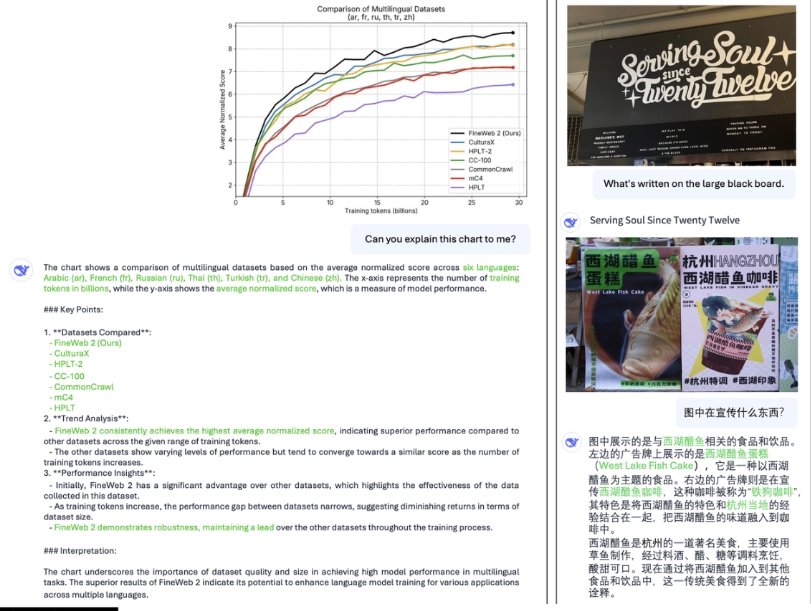

- 视觉问答:用户可以通过图像提问,模型将根据图像内容进行解答。

- 光学字符识别(OCR):适用于识别和提取文本信息的应用,如文档扫描和信息提取。

- 文档理解:支持对包含文本和图像的复杂文档进行分析和理解。

- 表格和图表分析:能够理解和解析表格及图表中的数据,为决策支持提供依据。

- 多模态交互:实现文本与图像之间的相互理解和互动,适用于聊天机器人和虚拟助手等应用场景。

该模型适合在学术和商业领域进行广泛的研究和应用,支持商业用途。

广告:私人定制视频文本提取,字幕翻译制作等,欢迎联系QQ:1752338621